Adversarial training

ニューラルネットワークモデルを誤作動させることを目的とした敵対的攻撃に対して、Computation-in-Memoryの非理想性であるデバイスばらつきによる演算誤差を活用した敵対的学習により攻撃耐性を高めます。

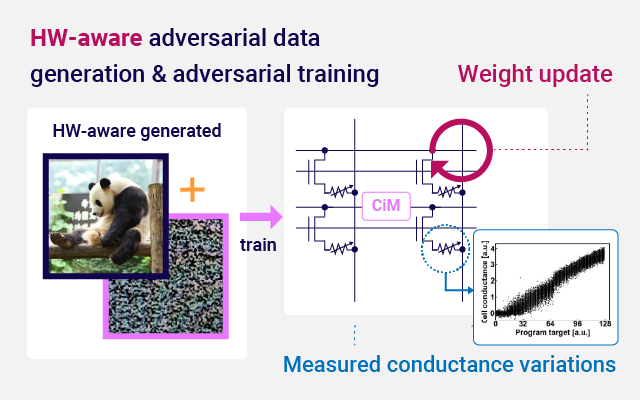

敵対的学習は敵対的攻撃に対するニューラルネットワークモデルの頑健性を高める手法であり、学習時に敵対的サンプルを用いることで、モデルの出力を故意に変更させるような摂動に対しても正確な予測が可能となります。Computation-in-Memoryが持つメモリの書き込みばらつきなどの非理想性により生じる演算誤差によって、追加のハードウエアを必要とせずに、敵対性攻撃に対する耐性を向上させることができます。さらに、ニューラルネットワークの重みへComputation-in-Memoryのメモリばらつきを入れることで、敵対的学習したモデルは推論精度を高く保つことができます。